© Lina Schubert / Studio Sprosse

Was Künstliche Intelligenz heute tatsächlich leistet – und was uns noch erwarten könnte.

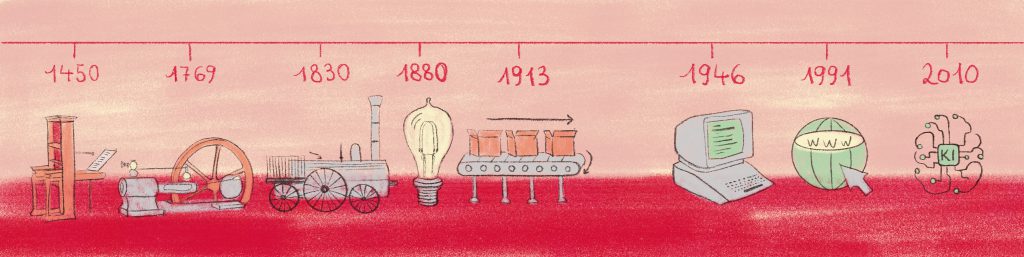

Der Buchdruck veränderte den Zugang zu Wissen. Die Industrialisierung ordnete Produktion und Arbeit neu. Mit der Elektrifizierung wurden ganze Wirtschaftsbereiche umgebaut, mit der Computerisierung und später dem Internet Kommunikation, Verwaltung und Öffentlichkeit. Technologische Entwicklung verläuft nicht linear, sie verdichtet sich immer wieder in Phasen, in denen neue Verfahren weit über ihren ursprünglichen Einsatzbereich hinauswirken.

In dieser Größenordnung wird inzwischen auch Künstliche Intelligenz diskutiert. Unternehmen betonen Produktivitätsgewinne, Technologiekonzerne tiefgreifende Innovationsschübe. Kritiker:innen wiederum verweisen auf neue Abhängigkeiten, steigenden Ressourcenverbrauch und ungelöste Fragen von Kontrolle über Haftung bis Regulierung. Gerade deshalb lohnt es sich, den Blick zunächst auf die Technologie selbst zu richten.

Nicht erst seit gestern da

Neu ist das Phänomen KI an sich nicht. Marlies Temper, Studiengangsleiterin für Data Intelligence sowie Data Science and Artificial Intelligence an der Hochschule für Angewandte Wissenschaften St. Pölten, erklärt die historische Entwicklung: „Der Begriff Künstliche Intelligenz wurde bereits in den 1950er Jahren geprägt. Prinzipiell handelt es sich um mathematische Verfahren, die mithilfe von Daten Wissen extrahieren und uns helfen können, Prognosen abzugeben, Empfehlungen abzuleiten oder Entscheidungen zu treffen.“

Breiter sichtbar wurde KI im Alltag zunächst über Anwendungen wie Sprachassistenten, automatische Übersetzung, personalisierte Empfehlungen oder Bilderkennung. So landete etwa Apples Sprachassistent „Siri“ erstmals 2010 auf den Endgeräten vieler Nutzer:innen.

Die Funktionsweise hinter Anwendungen wie ChatGPT ist auch heute dieselbe: Derartige Chatbots – in der Fachsprache auch generative KI genannt – werden mit großen Datenmengen trainiert und lernen durch die Analyse abertausender Dokumente, wie Texte oder Bilder aufgebaut sind und sich reproduzieren lassen.

„Rapide Verbesserungen in spezifischen Anwendungsgebieten zeigen sich mittlerweile innerhalb weniger Wochen.“

Marlies Temper

Hochschule für Angewandte Wissenschaften St. Pölten

„In den letzten zwanzig Jahren sind unsere Rechen- und Speicherkapazitäten um ein Vielfaches gestiegen. Gleichzeitig haben sich die Kosten stark reduziert“, betont Temper. Die Ursache für den jüngsten Boom an KI-Anwendungen liegt also weniger an technologischen Durchbrüchen der Technologie selbst, sondern an der breiteren Verfügbarkeit von zugrundeliegenden Daten und einer verbesserten technischen Infrastruktur.

Kluge Technologie oder kluges Marketing?

Gleichzeitig machen derartige Modelle die Technologie von einem Tag auf den anderen einer viel größeren Zielgruppe zugänglich. Die Ergebnisse sind unmittelbar erfahrbar: In Sekundenschnelle entstehen Texte, Bilder oder Videos. Noch dazu sind Einstiegsmodelle oftmals gratis nutzbar.

Dabei handle es sich jedoch nicht unbedingt um Großzügigkeit, sondern gezielte Marketing-Strategien: „Seitens OpenAI war es ein wirklich kluger Schachzug, dass Konsument:innen ihr Produkt gratis austesten können“, betont Temper. Aber es gibt auch eine zweite Seite der Medaille: „Wenn etwas gratis ist, dann ist man meist selbst das Produkt“, betont die Expertin weiter. Im Fall von generativer KI bedeutet dies, dass jede:r neue Nutzer:in auch eine neue Datenquelle darstellt. Jedes Dokument, das hochgeladen wird, jeder Chatverlauf und jede Eingabe, die gesammelt wird, verbreitert die Datenbasis des Systems und führt so zu einer Verbesserung der Modelle – sozusagen ein stetiger Kreislauf aus besseren Daten und besserer KI.

Dies erkläre auch die schnellen Entwicklungssprünge in den letzten Jahren. „Rapide Verbesserungen in spezifischen Anwendungsgebieten zeigen sich mittlerweile innerhalb weniger Wochen. Wir konnten beispielsweise im Bereich der Mathematik oder auch Programmierung beobachten, wie Modelle zuerst an Aufgabenstellungen scheitern und diese wenig später problemlos lösen können“, so Temper.

© Lina Schubert / Studio Sprosse

Das Spiel mit der Wahrscheinlichkeit

Mit „Lernen“ im menschlichen Sinne ist dieser Trainingsprozess aber trotzdem nicht gleichzusetzen: Denn Modelle verstehen Sprache nicht, sie analysieren sie. „Wie sind Sätze aufgebaut? Welche Wörter werden oftmals in Kombination verwendet?

So ist ‚lernen‘ in diesem Kontext zu verstehen. Was derartige Sprachmodelle produzieren, ist ein rein wahrscheinlichkeitsbasierter Aufbau von Sätzen“, erläutert Temper. Je besser die KI mit Spezialwissen trainiert ist, umso höher auch die Wahrscheinlichkeit, dass sie diese Wissensbasis gut reproduzieren kann. „Doch es ist kein Expertensystem, das hundertprozentiges

Wissen reproduziert. Dessen sollten wir uns bewusst sein“, appelliert die Expertin.

Sprachmodelle bilden jedoch nur einen Teilbereich im Gebiet der Künstlichen Intelligenz. In der Industrie wird KI etwa genutzt, um Materialfehler in Echtzeit zu erkennen, Wartungsbedarf frühzeitig vorherzusagen oder Produktionsabläufe effizienter zu steuern. In der Logistik hilft sie bei Nachfrageprognosen und Routenplanung, im Gesundheitsbereich bei der Auswertung von Bilddaten, etwa in der Krebserkennung. Derartige Automatisierungs-Prozesse sind seit Jahren Standard.

Expert:innen gefragt

Gerade darin liegt für Temper der eigentliche Schlüssel: nicht in der bloßen Verfügbarkeit der Technologie, sondern in ihrer gezielten Anwendung. Ob KI in Unternehmen tatsächlich zu Produktivitätsgewinnen führt, hängt stark davon ab, wofür sie eingesetzt wird. Es gibt bereits Studien, die positive Effekte zeigen, andere fallen deutlich zurückhaltender aus. „Am Ende hängt es davon ab, wofür ich die KI verwende“, sagt Temper. Dort, wo Systeme sinnvoll in bestehende Abläufe eingebettet werden, können sie Prozesse durchaus beschleunigen. Das gilt etwa für gut trainierte Chatbots auf Basis interner Unternehmensdokumente oder für Anwendungen, die Berichte abgleichen und Widersprüche in der Dokumentation erkennen.

© Arnd Ötting

„China und die USA sind uns hier deutlich voraus und haben weit früher begonnen, in diese Bereiche zu investieren.“

Marlies Temper

Hochschule für Angewandte Wissenschaften St. Pölten

Ein Selbstläufer sei es jedoch nicht. „Wenn ich die KI falsch einsetze, dann kostet sie mich unter Umständen sogar Zeit“, warnt Temper. Fehlerhafte Ausgaben können zusätzlichen Kontrollaufwand verursachen und damit den erhofften Effizienzgewinn rasch wieder relativieren. Auch für den Arbeitsmarkt plädiert sie deshalb für Nüchternheit. Dass ganze Berufsfelder kurzfristig verschwinden, erwartet sie nicht. „Wie jede Technologie verändert auch KI den Arbeitsmarkt“, sagt Temper.

Neue Tätigkeiten werden entstehen, in anderen Bereichen sinkt der Bedarf. Umso wichtiger bleibt Aus- und Weiterbildung. Denn damit KI-Systeme in Unternehmen gezielt, sicher und sinnvoll funktionieren, braucht es „Expert:innen, nicht bloß Anwender:innen“, sagt Temper. Entscheidend ist, dass Beschäftigte solche Systeme nicht nur nutzen, sondern sie fachlich einordnen, mit Wissen befüllen und verantwortlich einsetzen können.

Europas Chance

Mit der Frage nach Qualifikation rückt zwangsläufig auch die Frage nach Abhängigkeiten in den Vordergrund. Denn wer Künstliche Intelligenz entwickeln und einsetzen will, braucht nicht nur Modelle, sondern auch die technische Basis dahinter – von

Rechenleistung über Cloud-Infrastruktur bis Speicherkapazitäten. Genau dort sieht Temper Europas Schwäche: „China und die USA sind uns hier deutlich voraus und haben weit früher begonnen, in diese Bereiche zu investieren.“ Zwar gebe es mit Mistral einen europäischen Anbieter, insgesamt seien die USA und China technologisch jedoch deutlich voraus. Besonders heikel sei die Abhängigkeit von den Infrastrukturen großer US-Konzerne. Sie verweist auf Cloud-Dienste wie AWS, Google, OpenAI oder Azure, über die Speicherung und Verarbeitung möglich werden.

Statt sich nun verspätet in ein Wettrennen um die größten Sprachmodelle zu begeben, sollte Europa eine andere Strategie verfolgen, so Temper: „Spezialisierte Forschung, effizientere und nachhaltigere Algorithmen sowie Anwendungen, die näher an konkreten Problemen entwickelt werden, bieten echtes Potential, um einen Beitrag zu leisten.“

Nächster Schritt Weltherrschaft?

Wenn KI schon heute immer mehr Aufgaben unterstützt, wie realistisch ist dann die Vorstellung, dass sie irgendwann weit mehr übernehmen könnte? Diese Frage begleitet die KI-Forschung fast so lange wie ihr Bestehen. So sagte etwa der Wissenschaftler Herbert Simon bereits im Jahr 1965 voraus, dass Maschinen innerhalb von zwanzig Jahren jede Arbeit erledigen können würden, die auch Menschen leisten können. Die Prognose bewahrheitete sich bekanntermaßen nicht.

Stattdessen folgten auf Phasen großer Erwartungen immer wieder Rückschläge, Enttäuschungen und damit gekürzte Fördergelder – doch das Ziel blieb: Bis heute ist die Entwicklung einer allgemeinen Künstlichen Intelligenz das erklärte Ziel führender Tech-Unternehmer. Gemeint ist damit eine Form von Künstlicher Intelligenz, die nicht mehr nur einzelne, klar umrissene Aufgaben bewältigt, sondern auf breiter Ebene jene geistigen Fähigkeiten nachbildet, die man bislang nur mit menschlicher Intelligenz verbindet: lernen, schlussfolgern, Wissen auf neue Kontexte übertragen und Probleme flexibel lösen.

Wenn heute wieder intensiv über allgemeine Künstliche Intelligenz diskutiert wird, knüpft die Debatte also an ein altes Ziel der KI-Forschung an. Zugleich bleibt Zweifel angebracht. Denn die Prognosen reichen von wenigen Jahren bis zu mehreren Jahrzehnten, manche bezweifeln grundsätzlich, dass sich allgemeine Intelligenz in der derzeit diskutierten Form überhaupt erreichen lässt. Oder, wie Marlies Temper es zusammenfasst: „Darüber kann man aktuell nur spekulieren. Niemand kann in eine Glaskugel schauen.“

So viele Ressourcen verbraucht die KI

„KI ist heute nahtlos in viele Systeme integriert – sei es im Internetbrowser, eigenen Unternehmens-Chatbots oder eingebettet in Apps. Das sollte aber nicht darüber hinwegtäuschen, dass hinter jeder Eingabe enorme technische Mittel stecken – nämlich Rechenzentren mit entsprechendem Strom- und Wasserbedarf. Eine ChatGPT-Anfrage benötigt laut Schätzungen fast zehnmal so viel Strom wie eine klassische Google-Suche. Hochgerechnet auf rund 195 Millionen Anfragen pro Tag ergibt das einen Strombedarf von etwa 564.000 Kilowattstunden: so viel wie der Tagesverbrauch von rund 66.000 österreichischen Haushalten.“

Stromverbrauch steigt weiter

Hinter den smarten Technologien stecken Rechenzentren, Serverfarmen, Kühlsysteme und eine technische Infrastruktur, die enorme Mengen an Strom, Wasser und Rohstoffen benötigt. Bis 2030 könnte sich der Bedarf laut Internationaler Energieagentur noch einmal verdoppeln.

Je selbstverständlicher die Anwendungen in den Alltag einziehen, desto leichter gerät aus dem Blick, welcher materielle Aufwand hinter ihrer scheinbar mühelosen Nutzung steht. Gerade deshalb sollte die Debatte über Künstliche Intelligenz nicht beim technologisch Machbaren enden. Sie muss auch danach fragen, wie die digitale Entwicklung nachhaltig gestaltet werden kann. Denn die entscheidende Frage lautet nicht nur, was KI kann – sondern auch, was ihr Einsatz kostet.